AI e cigni neri: Massimo Buscema e l’arte di vedere l’invisibile

Il matematico Massimo Buscema spiega perché l’intelligenza artificiale del futuro non guarderà il passato, ma leggerà i segnali deboli nascosti nel presente. Una rivoluzione silenziosa contro la tirannia dei Big Data. Ecco come un matematico romano guarda oltre i giganti della Silicon Valley con algoritmi che analizzano anomalie in dataset storici e rilevano segnali precoci in immagini diagnostiche invisibili all’analisi convenzionale. Un nuovo approccio europeo all’AI che cerca segnali deboli invece di pattern storici.

Massimo Buscema ha sviluppato algoritmi che analizzano anomalie in dataset sismici storici, che in un caso documentato hanno rilevato anomalie in immagini diagnostiche tre anni prima della diagnosi clinica, e che scoprono contaminazioni radioattive dove nessun sensore le aveva cercate. Tutto senza big data, senza GPU da migliaia di dollari, guardando solo il “rumore” che i grandi modelli ignorano.

È novembre 2025, IT’S WEEK a Rimini. Il matematico romano, direttore del Semeion Research Center e professore all’University of Colorado, sale in cattedra sul palco, ad ascoltarlo una platea di centinaia di persone, per spiegare perché l’intelligenza artificiale del futuro non guarderà più il passato.

Da quarant’anni studia e costruisce algoritmi che vedono l’invisibile. Mentre i giganti della Silicon Valley accumulano compulsivamente petabyte di dati e GPU da migliaia di dollari per addestrare modelli che guardano solo al passato, Massimo Buscema ha scelto una strada diversa. Una strada che non insegue i big data, ma li dribbla. Che non cerca pattern nelle frequenze, ma nelle anomalie. Che non prevede il futuro guardando lo specchietto retrovisore, ma decifrando i sussurri del presente. E’ l’intelligenza artificiale investigativa. O, come la chiama lui, “previsione armonica”. A differenza delle previsioni probabilistiche usa un approccio che suona quasi metafisico, ma che nelle sue ricerche ha dimostrato di poter analizzare pattern anomali in dati sismici, rilevare anomalie in immagini diagnostiche, e ha ben ricostruito dispersioni di contaminanti radioattivi.

“Non si ferma una locomotiva che va avanti da 40 anni con uno stuzzicadenti”, esordisce Buscema con la franchezza di chi conosce bene i propri limiti e i propri punti di forza. La locomotiva sono gli Stati Uniti e la Cina, che da decenni costruiscono data center sempre più grandi, GPU sempre più potenti, reti neurali sempre più profonde. “Ma c’è una parte dell’intelligenza artificiale che non è stata sviluppata”, prosegue. “E potrebbe essere il futuro che noi potremmo cavalcare. Si tratterebbe un po’ come cavalcare un fotone, muoversi alla velocità della luce”.

Stormi, atomi e la danza della complessità

Buscema proietta un’immagine. Stormi di uccelli. “Vedete gli uccelli? Sono distribuiti in maniera completamente casuale quando si alzano. Un attimo dopo che si sono alzati, cominciano a disegnare geometrie incredibili”. Geometrie ipnotiche, impossibili da prevedere osservando il singolo volatile. “Nessun uccello ha in testa, o nel suo cervello, il modo con cui si organizzano insieme”, spiega. È un fenomeno che i matematici chiamano “emersione spontanea dal basso della complessità”. Lo stesso identico principio per cui gli atomi si legano in molecole, molecole si assemblano in amminoacidi, più amminoacidi si ripiegano in complesse strutture proteiche. Ogni passaggio un salto evolutivo. Ogni livello è qualcosa di più, qualcosa di radicalmente diverso, rispetto alla somma delle sue parti.

“A cosa mira questa intelligenza artificiale che io chiamo investigativa?”, si chiede Buscema. “A capire le regole tramite le quali i comportamenti individuali spontaneamente si organizzano in comportamenti collettivi. E quindi a svelare le informazioni nascoste che sono incastonate e invisibili già nel presente”.

Qui sta la differenza fondamentale. L’AI che conosciamo, quella dei Large Language Models, quella che genera immagini da prompt, quella che ChatGPT usa per rispondere, si basa su un presupposto diverso: apprendere dal passato per prevedere il futuro. Trovare gli iper-parametri della funzione dei dati storici. Memorizzare milioni di esempi. Riconoscere pattern ricorrenti.

Specchietti retrovisori e viottoli di montagna

Buscema non sottovaluta l’importanza di questo approccio. Ma ne evidenzia i limiti con un’analogia chirurgica: “È come guidare una macchina guardando non il parabrezza, ma lo specchietto retrovisore”. Certo, se hai una memoria potentissima, se hai visto milioni di chilometri di strade, guardando un metro davanti a te puoi trovare l’analogia con quello che hai già percorso. E arrivi a destinazione.

“Adesso immaginiamoci però che quella strada diventi un viottolo di campagna o di montagna”, continua. “Nel mio training questo tipo di strade non ci sono. La funzione cambia improvvisamente. Come quando accendo il fornello: temperatura ambiente prima, 1000 gradi un attimo dopo; in mezzo non so cosa è successo”.

Tutti i cigni neri, gli eventi rari, imprevedibili, catastrofici, questo tipo di apprendimento li ignora. Sempre. Perché si basa su probabilità, su frequenze, su fenomeni che sono già avvenuti abbastanza volte da essere codificati. “La sabbia che cede il posto alle onde che annunciano lo tsunami è un evento talmente raro che non verrebbe codificato”, spiega.

L’esempio dell’allocco è illuminante. Nelle previsioni probabilistiche, una rete neurale profonda che ha visto milioni di gatti in posizioni diverse, ma solo pochi, 10-15, allocchi. Quando appare un nuovo allocco da classificare, la rete dirà: gatto. Perché? “Tutte le code delle distribuzioni gaussiane vengono tagliate durante l’apprendimento. E per cui diventa più probabile che sia un gatto. Ma non è un gatto, è un allocco”.

Buscema cita un paradosso storico con ironia tagliente: “Se la strada cambia improvvisamente, questo approccio non funziona più. E se applicassimo lo stesso approccio nel 1600, a Tolomeo e a Copernico, ci verrebbe detto che Tolomeo aveva ragione”.

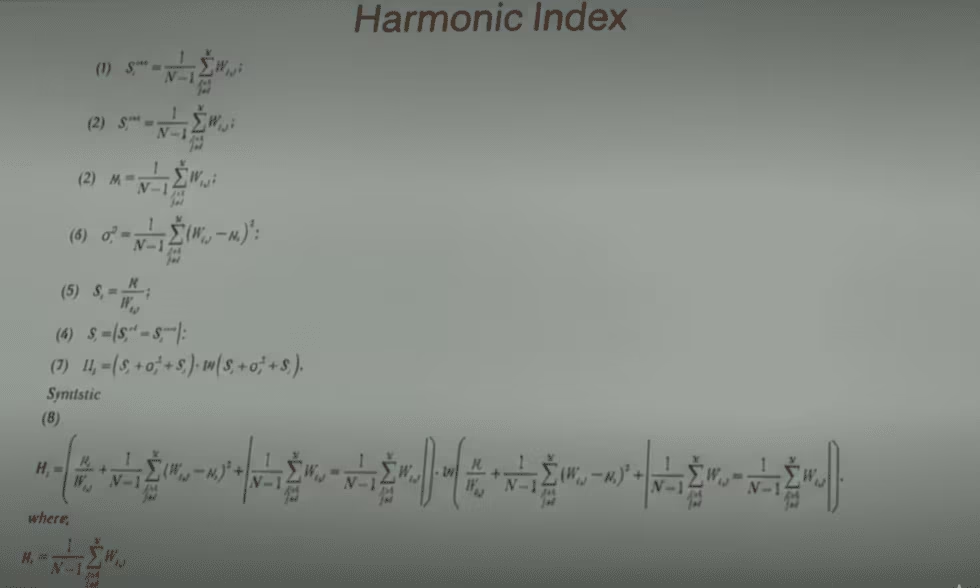

Harmonic Prediction: dal rumore alla musica

E allora come si fa? Come si catturano i segnali deboli prima che si amplifichino? La risposta di Buscema è contro-intuitiva: guardando il rumore. O meglio, quello che scambiamo per rumore.

“Immaginate un concerto che avviene nella radura di un bosco”, dice: “Se io ascolto da fuori il bosco, sento soltanto i bassi e la batteria”. Le alte frequenze, la chitarra, la voce, vengono “spezzettate” dagli ostacoli come i tronchi degli alberi, diventano coriandoli che si confondono col fruscio delle foglie. Ma ci sono. “Si tratta di capire come si può ricostruire da questo, che vediamo arrivarci come un semolino, i bucatini all’amatriciana che erano all’origine”.

La previsione armonica ha il compito di “trasformare una parte del rumore in musica”. Secondo Buscema, una quota significativa di quello che scambiamo per rumore potrebbero essere informazioni chiave. Segnali deboli che annunciano ciò che avverrà, pattern nascosti nelle pieghe della media.

Mostra un’immagine. Grigia, indistinta. Rumore. Il sistema la elabora. Pian piano emerge qualcosa: un tigrotto. “È emerso dal rumore di fondo”, commenta. Il sistema non aveva visto altre immagini, non aveva esempi di tigri nascoste. Aveva solo quella foto. E ha saputo estrarre l’informazione nascosta.

Due polmoni su una TAC. Due lesioni evidenti. Dopo l’elaborazione armonica: quella che sembrerebbe una rete di deformazioni vascolari intorno, invisibili all’occhio umano. “Quelle deformazioni dei vasi linfatici che le lesioni stanno già producendo”, spiega Buscema. Il sistema avrebbe individuato che le due lesioni sono in realtà una sola che si biforca, tracciando anche il perimetro di operabilità.

Quando il tigrotto emerge dal nulla

Buscema descrive una serie di casi clinici. Un’arteria poplitea femorale, appena operata. Il chirurgo: “Non c’è più niente”. Il filtro normale conferma: tutto pulito. Poi il sistema che cerca risonanze inizia a lavorare. “I vari pixel di quell’immagine hanno cominciato a parlare tra loro, a scambiarsi le informazioni come degli agenti”, descrive Buscema con un’immagine quasi poetica. “A un certo momento si sono messi d’accordo ed è venuta fuori questa immagine”. Una stenosi. Che c’era.

Secondo Buscema, il suo team ha osservato diversi casi, dello stesso fenomeno. Anche se si tratta di dati aneddotici, non ancora supportati da validazione clinica sistematica con campioni statisticamente significativi.

Ma è il caso della TAC polmonare quello che fa gelare il sangue. Un paziente con una piccola “ground glass opacity” un’opacità lieve, comune. “Guarda, queste ce l’hanno molte persone, non significa niente, torna tra qualche mese”. Il paziente torna dopo tre anni. Lesione neoplastica maligna, stadio avanzato. È un caso singolo, Buscema stesso non lo nasconde, e come tale va letto. Ma quello che succede dopo è difficile da ignorare. Buscema e il suo team elaborano l’immagine originale di tre anni prima. Solo quella. Il sistema traccia lentamente una forma. Una lambda, che diventa progressivamente una A. Poi si ferma.

“Abbiamo visto tre anni prima quello che sarebbe avvenuto tre anni dopo”, dice Buscema con tono piano. “Potevamo agire prima. Forse salvare anche qualche vita”. Un caso singolo, analizzato in modalità retrospettiva su un’immagine già nota come patologica: una dimostrazione di principio che attenderebbe conferma attraverso studi prospettici su larga scala prima di poterne valutare la reale capacità diagnostica.

Applicazioni reali: caldaie, terremoti, Fukushima e camorra

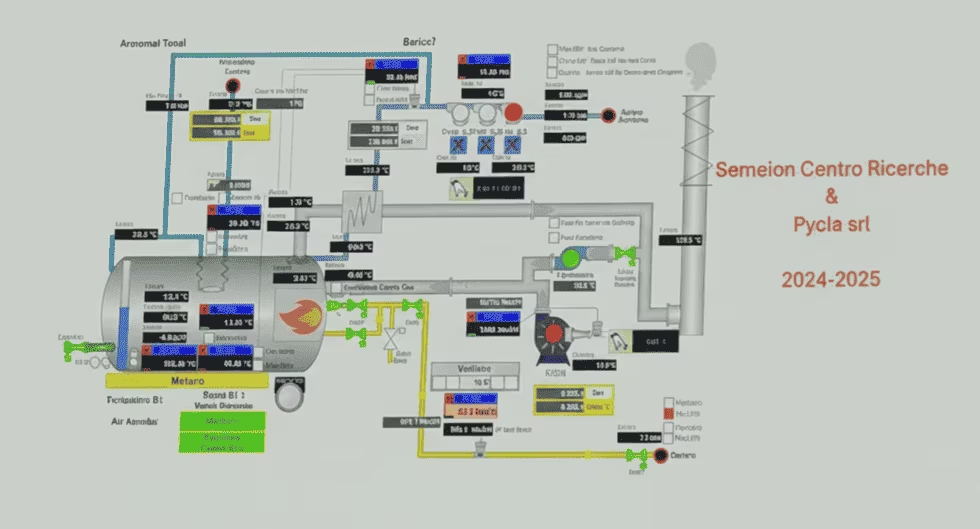

Non è solo medicina. Il sistema PICLA (Pattern Identification in Complex Logic Anomalies) individua anomalie in sistemi complessi.

La caldaia

Una caldaia con 39 sensori, tutti apparentemente normali. Eppure l’efficienza calava improvvisamente. Si pompa metano per riportarla su. Calava di nuovo. Si pompa di nuovo. PICLA identifica quattro segnali deboli, quattro anomalie nascoste nei dati normali.

Tre sensori. “Ad un esame tecnico sembravano normali”, spiega Buscema. Ma stavano alterando il funzionamento della caldaia. I quattro punti anomali hanno annunciato in anticipo che l’efficienza sarebbe crollata. Identificazione predittiva di eventi anomali. “Le anomalie pericolose sono nascoste all’interno del flusso normale”, sintetizza. “E quindi individuarle è difficile”.

I terremoti

Dataset mondiale 1976-2002. L’obiettivo: analizzare pattern anomali e stimare la magnitudo. Pubblicato sul Bollettino di Geofisica Teorica e Applicata. Il sistema individua eventi rari, terremoti anomali che potrebbero essere correlati ad altri eventi.

Un’analisi retrospettiva sull’Italia, ottobre 2012, con pattern che il sistema avrebbe identificato in anticipo secondo i ricercatori, un’ipotesi di lavoro ancora tutta da verificare in condizioni prospettiche, ovvero prima che gli eventi si verifichino. “Non è perfetta, ma ci accontentiamo dello 0.5 di approssimazione in magnitudo?”, chiede Buscema. “Se ci accontentiamo possiamo migliorare”. La filosofia è semplice: “Il futuro entra nel presente in piccoli passi”.

Fukushima

3.467 sensori per misurare il Cesio radioattivo che lo tsunami ha liberato dall’esplosione della centrale. Qui entra in gioco il TWC, Topological Weighted Centroid, un sistema di profilazione geografica che lavora su coordinate spaziali per trovare l’origine di un processo. Il sistema fa la sua stima. Due macchie rosse. Una su Fukushima, ovvio. Ma l’altra? A metà strada tra il punto dello tsunami e Fukushima. In mezzo al mare.

“Ci sembrava inspiegabile”, racconta Buscema. Poi, secondo la ricostruzione del team, i tecnici giapponesi spiegano: gran parte del Cesio è andato in mare, una quota minore sulla terra. Nel punto della macchia rossa c’è una fossa sottomarina che passa da 300-400 metri a 3.000 metri. Le pietre sul fondale avevano assorbito Cesio. Lo tsunami le ha frantumate. E le correnti hanno riportato quel Cesio sulla costa. Sorgente secondaria, individuata da segnali deboli invisibili ai sensori convenzionali. “Le due sorgenti erano esatte. Non avremmo mai capito questo”.

La camorra

È il caso forse più impressionante. E quello con la validazione più solida, perché non viene da un laboratorio, ma da un’indagine di polizia reale con esiti giudiziari verificabili. Nel luglio 2008 il ROS (Reparto Operativo Speciale dei Carabinieri) porta a Buscema un caso spinoso. L’Indagine Taurania, parte del cosiddetto Progetto Magellano: 62 soggetti sotto osservazione, 778 variabili ciascuno. Le indagini tradizionali erano arrivate a un punto morto. Stavano per essere chiuse.

Buscema applica Auto CM, una rete neurale sviluppata al Semeion in cui ogni nodo non impara solo la propria porzione di dati, ma sviluppa una conoscenza olistica dell’intero dataset. Il sistema lavora senza sapere nulla dei due clan. Zero informazioni sulla struttura esistente. Solo dati grezzi. Il risultato lascia di stucco i carabinieri. Auto CM separa spontaneamente i due clan con appena due errori su 62. Su sessantadue soggetti. Senza che nessuno gliel’abbia detto dove stava il confine.

Ma non è questo il colpo di scena. Il sistema identifica tre soggetti che le indagini tradizionali avevano completamente trascurato. Il più importante dei quali risulta essere il nodo più protetto dell’intera rete criminale. Una posizione che, come scrivono poi gli stessi investigatori nel rapporto ufficiale, “non era mai emersa durante le indagini”. La stima del sistema è quasi chirurgica: la rimozione di quel soggetto avrebbe indebolito la struttura della gang di quasi il 30%.

I Carabinieri del ROS, nelle loro slide ufficiali dell’Indagine Taurania, confermano che il sistema ha permesso di identificare soggetti “più protetti all’interno della propria struttura organizzativa” e “più influenti nel grafo complessivo”, definendolo “di alta utilità l’analisi tattica per guidare le scelte investigative”. L’analisi venne poi ripetuta su tutti i 1.112 soggetti dell’indagine, con 8.586 variabili, e il sistema ha correttamente posizionato nei clan anche soggetti non inclusi nell’analisi iniziale, poi confermati dagli Ordini di Custodia Cautelare.

Una voce diversa: il nodo della replicabilità

Non tutti nella comunità scientifica condividono l’entusiasmo. Chi lavora nell’ambito del machine learning applicato alla diagnostica per immagini tende a sollevare una questione metodologica precisa: la differenza tra un risultato ottenuto su un caso singolo e una capacità dimostrata su campioni ampi e indipendenti.

“L’approccio ai segnali deboli è concettualmente interessante”, spiega un ricercatore di un laboratorio europeo di AI medica che preferisce non essere citato, “ma il salto da una dimostrazione di principio a uno strumento clinicamente affidabile richiede validazioni che, al momento, non sono state pubblicate in forma sistematica”.

Buscema non ignora il problema, lo riconosce apertamente, e indica nella scarsità di risorse istituzionali il principale ostacolo alla costruzione di dataset su larga scala. Il dibattito, insomma, è aperto. E questo, per una ricerca che si autodefinisce in fase esplorativa, è esattamente il punto in cui dovrebbe trovarsi.

Il fotone contro la locomotiva

Ma c’è un punto che Buscema tiene a sottolineare, quasi provocatorio. Non servono sempre enormi quantità di memoria e GPU. “Non è vero. Non in tutti i casi”, dice con fermezza. “Per gli LLM sì. Ma gli LLM servono soltanto a livello linguistico”. Il suo modello è diverso: gli LLM traducono il problema che esprimi in linguaggio naturale in termini matematici. I sistemi di previsione armonica capiscono le informazioni nascoste. Poi, e solo poi, gli LLM tornano utili per tradurre quello che hanno trovato in linguaggio comprensibile. “E non è cosa da poco”, ammette.

Ma il grosso del lavoro, il lavoro investigativo, avviene con sistemi più leggeri, più veloci. Software da PC. Tempo di elaborazione reale. Non data center da miliardi.

La filosofia che propone è quasi democratica: “È inutile costruire per un problema una grande rete neurale, ma sono meglio tante piccole reti, ognuna che esprime un punto di vista diverso sugli stessi dati”. Combinandole insieme si va molto sopra il livello di accuratezza della singola rete grande. “Come dire: meglio una democrazia in cui ci sono anche dei deficienti, che una tirannia illuminata che quando si sbaglia la fa grossa”.

Anche la rete piccola più “sciocca” può vedere delle cose che le reti migliori non vedono. Buscema cita Stephen Hawking: “Immaginate se, su un principio darwiniano, a 21 anni Stephen Hawking sarebbe stato magari buttato fuori dalla rupe tarpea. Cosa ci saremmo persi?”. Molti punti di vista sono meglio di uno. “Cosa banale, semplice, ma applicata a questo campo rivoluzionaria”.

L’Europa che non c’è (ancora)

Buscema conclude con una visione strategica. “Questa io credo che potrebbe essere l’evoluzione europea o italiana dell’intelligenza artificiale su cui argomento non abbiamo competitors”. La maggioranza dei centri di ricerca lavora su passato che predice il futuro. Pochi, pochissimi, lavorano sul presente che contiene il futuro. “In altre parole: chi non è in grado di vedere il futuro nel suo presente, non è in grado neanche di capire il suo passato”.

È una dichiarazione forte. Quasi un manifesto. L’idea che mentre Stati Uniti e Cina si sfidano a colpi di data center e miliardi di parametri, l’Europa, e l’Italia in particolare, potrebbe tracciare una via diversa. Non la forza bruta dei big data, ma l’eleganza matematica della topologia. Non milioni di esempi, ma la capacità di leggere ciò che è già scritto nel presente.

La filosofia che ricorre in tutto l’intervento è questa: “C’è molta informazione in ogni piccola cosa”. E ancora: “Ogni cosa visibile ne nasconde altre invisibili”. Non serve accumulare montagne di dati se non sai vedere quello che è già davanti a te, nascosto nel rumore. Quarant’anni di ricerca per costruire algoritmi che identificano eventi anomali. Che trasformano il rumore in musica. Che fanno “pettegolare” i pixel fino a far emergere stenosi invisibili. Che analizzano pattern sismici e rilevano anomalie in immagini diagnostiche leggendo segnali deboli.

“La natura annuncia sempre quello che sta per fare”, dice Buscema. “Si tratta di capire praticamente, non prevedere il futuro in analogia al passato, ma leggere nel presente quei segnali nascosti che si amplificheranno per risonanza in eventi futuri”.

Dalla sua torre di matematico a Roma, Massimo Buscema ha passato una vita a costruire occhi che vedono l’invisibile. Mentre il mondo rincorre la locomotiva dei big data, lui ha scelto di cavalcare il fotone. E forse ha ragione quando dice che su questo terreno, le previsioni armoniche, i segnali deboli, le informazioni nascoste, l’Italia e l’Europa hanno ancora qualcosa da dire. Basta avere il coraggio di guardare dove tutti gli altri non guardano. Nel rumore. Nel presente. In quei segnali deboli che, per ora, continuiamo a scambiare per semolino.

Fonti

- Riferimento: “AI: A Broad and a Different Perspective”, Springer 2025 .

- Massimo Buscema. AI: A Broad and a Different Perspective”, Springer 2025

- Massimo Buscema IT’S WEEK